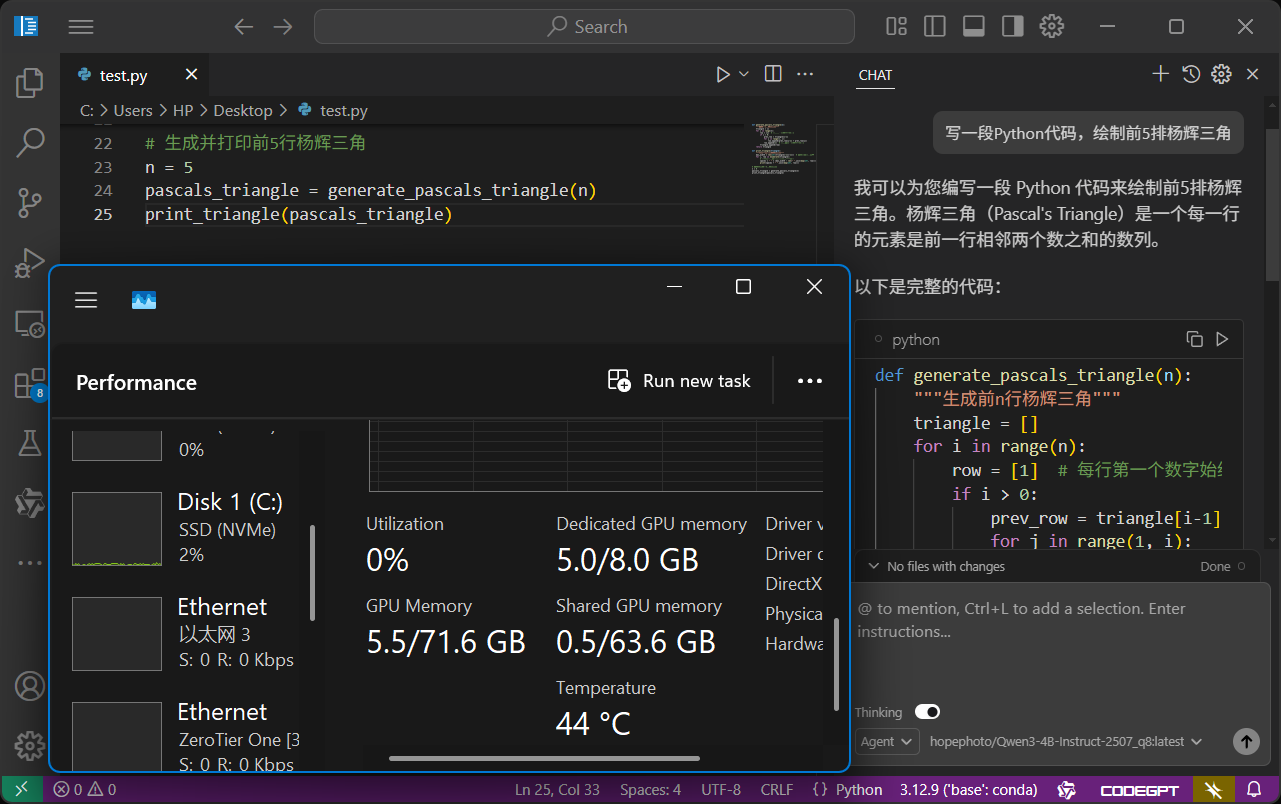

之前的文章介绍了Void 编辑器, 又介绍了基于 Ollama 的 Qwen3-4B-2507 模型部署,这个模型特别轻量级,甚至可以在千元红米手机上流畅运行Qwen3-4B-2507

实测Void+Ollama+Qwen3-4B-2507 构建本地离线AI辅助开发环境,在4060 8G显卡的笔记本上可谓飞快了。

本文就是整理出来的一份一站式安装与使用指南,覆盖 Windows 与 Ubuntu 24.04,包含四个部分:Void安装、Ollama安装、模型获取、Void配置,更适合新手朋友。

0 安装前准备

- 硬件与系统

- Windows 10/11 x64,或 Ubuntu 24.04 x86_64

- 内存 ≥ 8 GB(推荐 16 GB),磁盘空余 ≥ 10 GB

- 可选 GPU(NVIDIA 有助于加速,但 Qwen3-4B 在 CPU 上也可用)

- 网络

- 需能访问

ollama.com拉取模型;网络受限时可先离线安装 Void 与 Ollama,再为模型拉取配置代理 - 组件

- Void 编辑器 GitHub Releases

- Ollama 下载页

- Qwen3-4B 模型(思考版与指令版,后面通过ollama pull获取):

hopephoto/qwen3-4b-thinking-2507_q8、hopephoto/qwen3-4b-instruct-2507_q8

1 Void 安装

1.1 Windows

- 官方发布页:Void binaries releases

- 示例版本:

- Windows 安装包:VoidSetup-x64-1.99.30044.exe

- 百度网盘镜像:

- Void:下载链接 提取码:

cugb - 安装步骤

- 双击安装程序,按向导完成。

- 首次启动可暂不配置 AI,待安装好 Ollama 后再接入。

1.2 Ubuntu

- 官方发布页:Void binaries releases

- 示例版本:

- Ubuntu 安装包:void_1.99.30044_amd64.deb

- 安装命令

wget -O void.deb https://github.com/voideditor/binaries/releases/download/1.99.30044/void_1.99.30044_amd64.deb

sudo dpkg -i void.deb || sudo apt -f install -y

# 如有依赖问题:

# sudo apt --fix-broken install -y && sudo dpkg -i void.deb

2 Ollama 安装

2.1 Windows

- 官网下载页:Ollama Download

- Windows 安装包:OllamaSetup.exe

- 百度网盘镜像:

- Ollama:下载链接 提取码:

cugb - 安装后验证(PowerShell)

ollama --version

# 如提示未识别命令,重开 PowerShell 或重新登录系统再试

2.2 Ubuntu

- 一键安装

curl -fsSL https://ollama.com/install.sh | sh

- 安装后验证(Bash)

ollama --version

3 模型获取

- 拉取 Qwen3-4B 模型(思考版与指令版)

ollama pull hopephoto/qwen3-4b-thinking-2507_q8

ollama pull hopephoto/qwen3-4b-instruct-2507_q8

ollama list

- 注意

- Ollama的默认服务地址为

http://127.0.0.1:11434。若端口占用,可设置环境变量OLLAMA_HOST=127.0.0.1:PORT后重启服务。 - 若模型列表为空,先确认网络或镜像源是否可用,再次执行上面的

ollama pull加上模型名字的过程。

4 Void 配置

1) 启动 Void 并打开设置

- 如果没设置过,会出现下面的欢迎界面。

- 如果已经设置过了就打开 Settings → AI / Providers,也能修改设置。

- 确保前文已安装好 Ollama 并在本机运行。

- 说明:若版本较旧,建议先升级,以获得更好的兼容性。

- 说明:若版本较旧,建议先升级,以获得更好的兼容性。

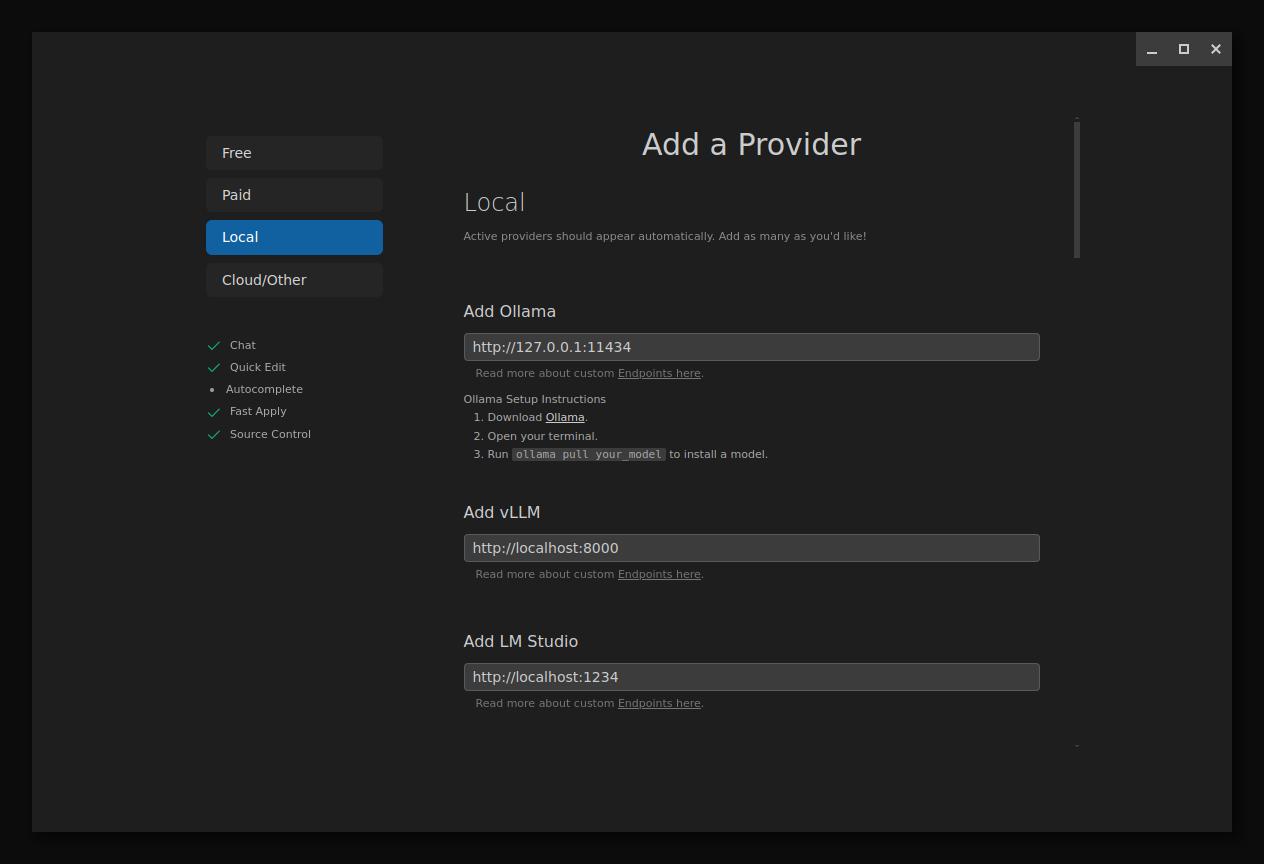

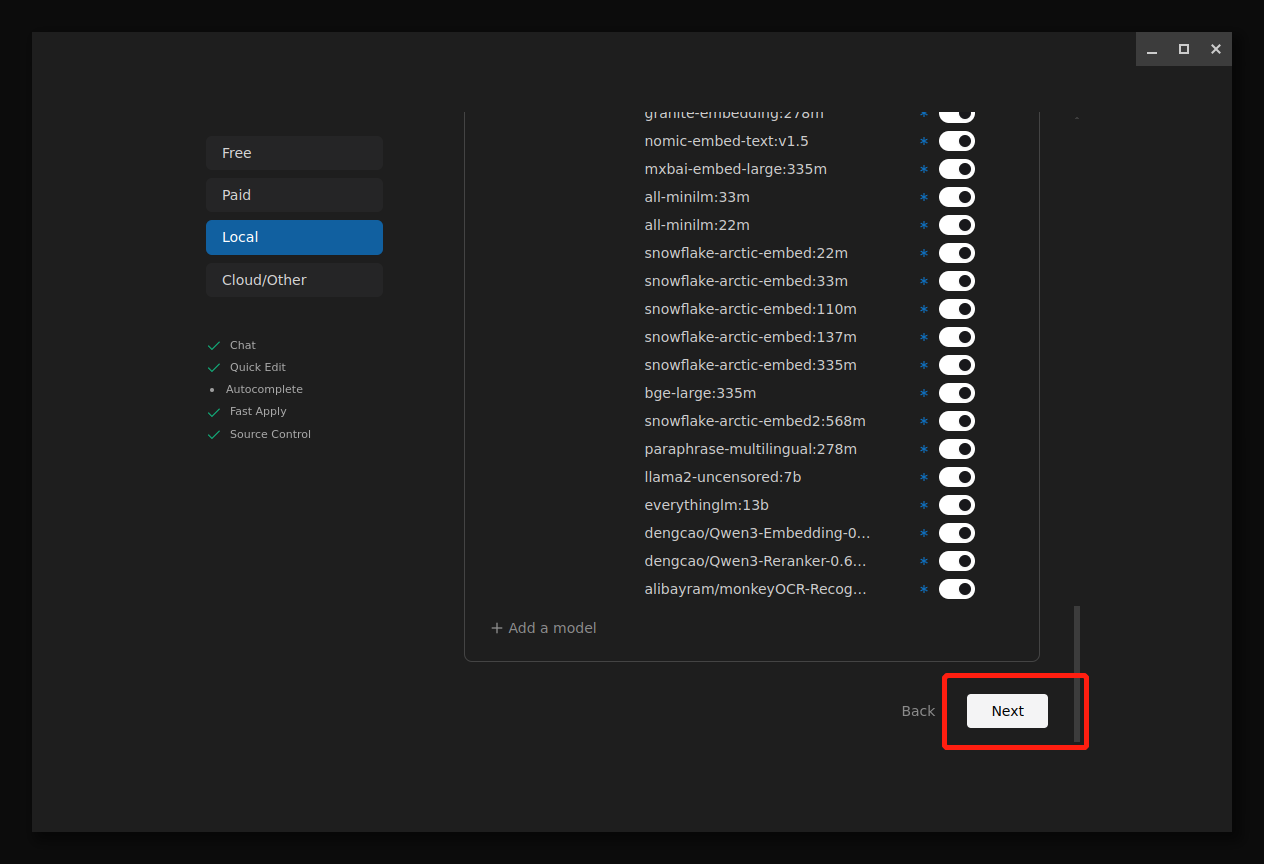

2) 选择本地 Ollama 作为提供者

- 在 Provider 类型中选择 Local(本地)/ Ollama。

- Base URL 默认就是填写的 http://127.0.0.1:11434。

- 说明:若端口被占用或自定义,请按实际端口填写。

- 说明:若端口被占用或自定义,请按实际端口填写。

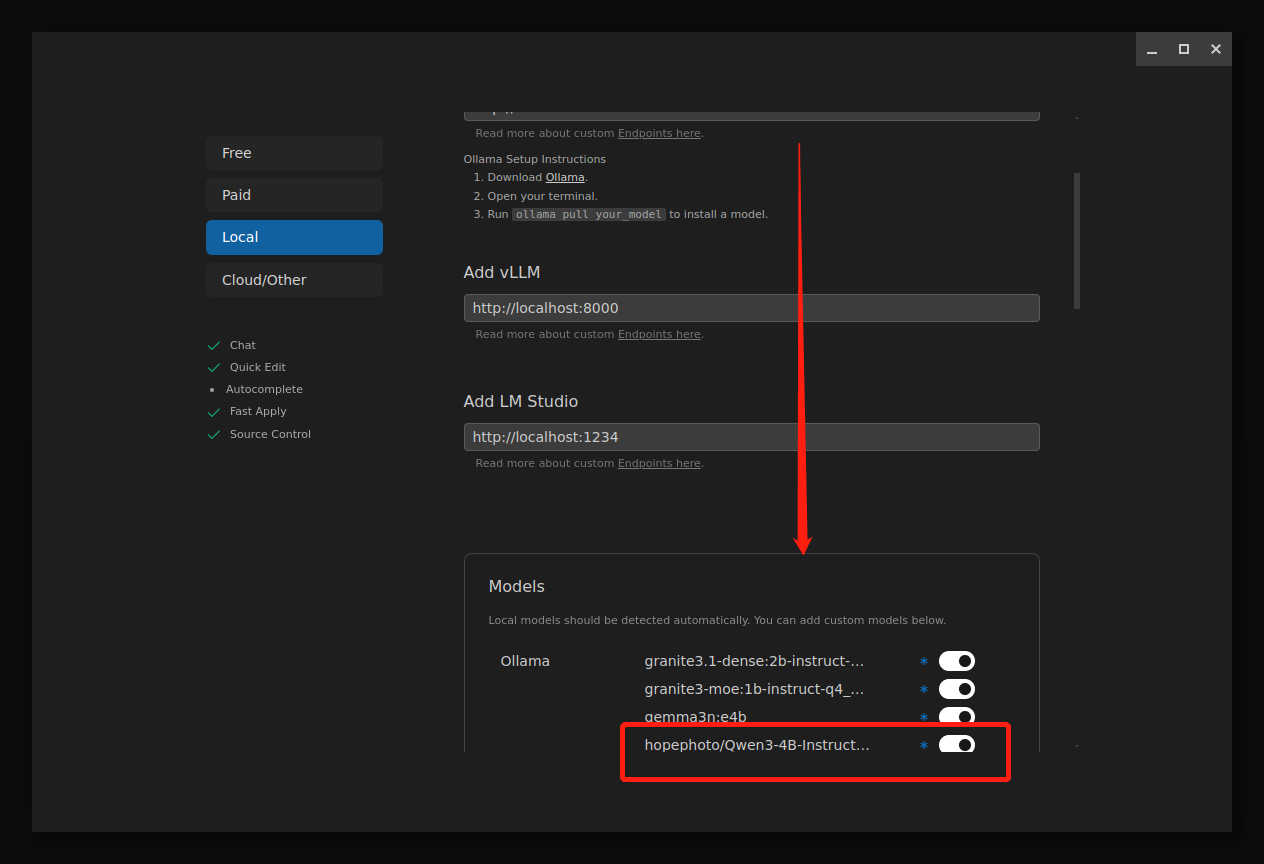

3) 滚动并查找本地模型

- 在模型列表中滚动,找到 hopephoto/qwen3-4b-thinking-2507_q8 与 hopephoto/qwen3-4b-instruct-2507_q8。

- 说明:若列表为空,优先在终端执行

- 说明:若列表为空,优先在终端执行 ollama list 确认模型已成功拉取。

4) 点击 Next 继续配置

- 保持默认设置,点击 Next(下一步)。

- 说明:如需更改默认参数(例如上下文长度、并发度),可在后续设置中调整。

- 说明:如需更改默认参数(例如上下文长度、并发度),可在后续设置中调整。

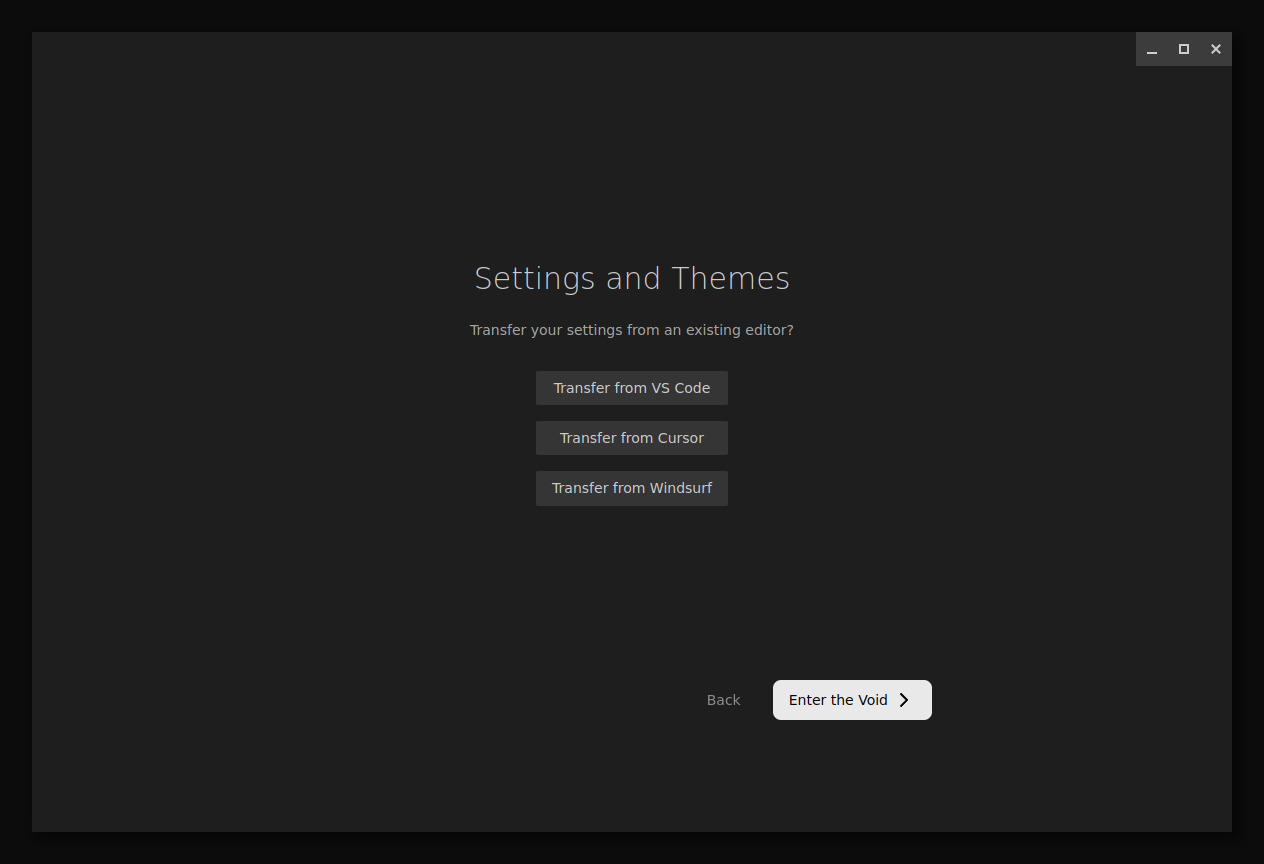

5) 导入插件,按向导完成

- 可能提示你是否从其他编辑器导入插件,如是则按提示导入,否则可跳过。

- 注意:微软官方的一些插件好像不让开源版本用。

- 注意:微软官方的一些插件好像不让开源版本用。

6) 勾选要启用的模型

- 选中 hopephoto/qwen3-4b-thinking-2507_q8 和/或 hopephoto/qwen3-4b-instruct-2507_q8,确认保存。

- 说明:思考版更擅长复杂推理,指令版更适合日常问答与代码指令执行。

- 说明:思考版更擅长复杂推理,指令版更适合日常问答与代码指令执行。

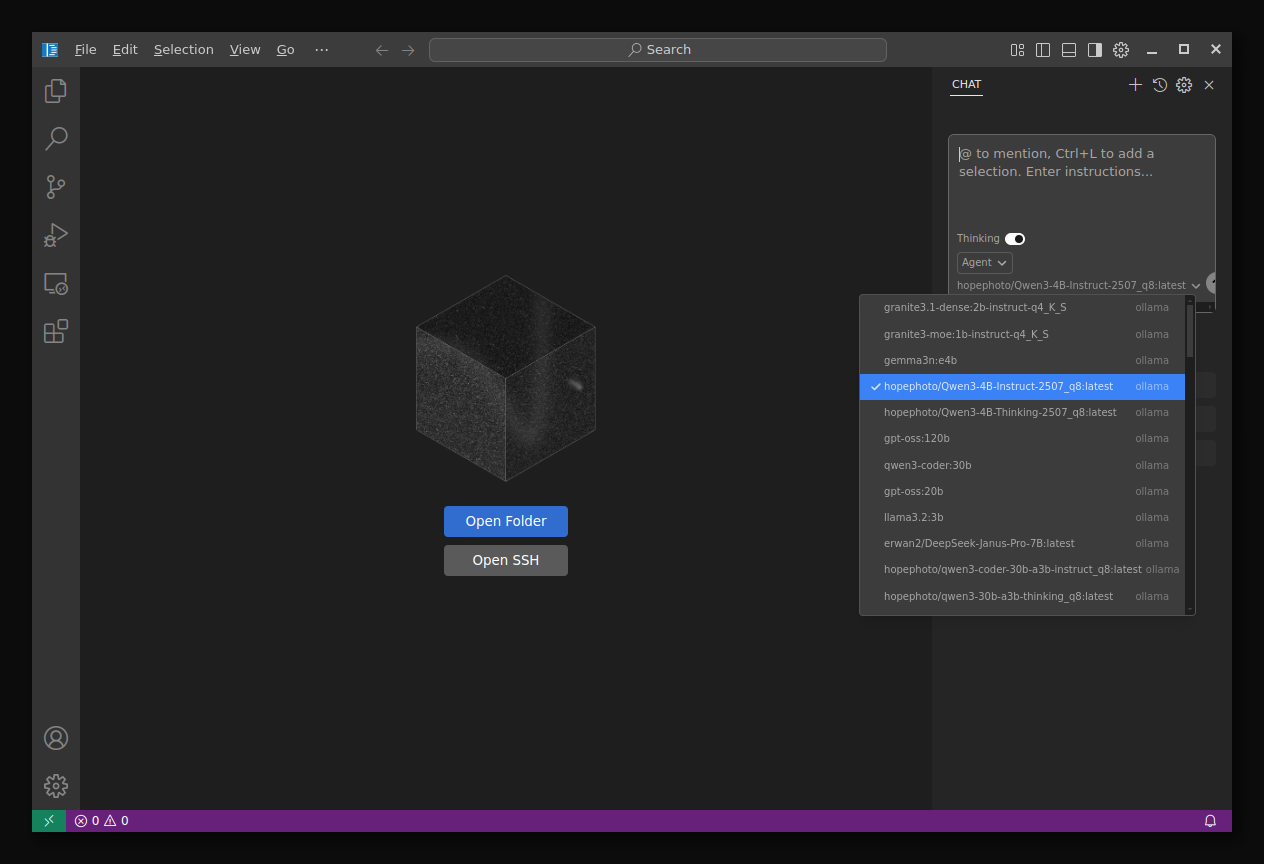

7) 完成接入并开始使用

- 在聊天/补全面板中选择对应模型开始对话或生成代码。

- 说明:若响应异常,优先检查 Ollama 是否在运行,以及

- 说明:若响应异常,优先检查 Ollama 是否在运行,以及 http://127.0.0.1:11434 是否可访问。

CycleUser

CycleUser